第1回 魁!! GPUクラスタ on GKE ~GPUクラスタ構築編~

ドーモ、動物ファーストエンジニアの吉海です。

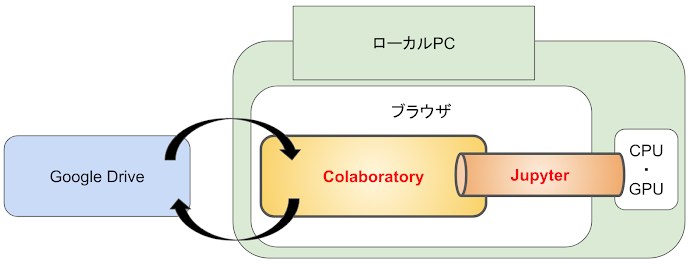

今回は魁読者必見のGoogle Container Engine(通称GKE)を使ってGPUクラスタを構築する方法をご紹介します。

GKEは最近のアップデートによりアルファクラスタでGPUクラスタが構築出来るようになりました!ただ、GPUが使えるようになるまでに一手間あったので、それをまとめてブログを書いてみました。

今回の記事は2部構成になっています。

- 第1回 GPUクラスタ構築編(本記事)

- 第2回 PodからGPUを使う方法

本記事の構成は以下のようになっています。

- なぜGPUクラスタ on GKEなのか

- GPUクラスタの作成手順

対象読者

- Kubernetesを使ったことがある方

- Google Container Engineを使ったことがある方

- 魁たい方

検証環境

Kubernetes側の環境

- Google Container Engine 1.7.5

- Kubernetes 1.7.5

クライアントの環境

- macOS Sierra 10.12.6

- kubectl 1.7.3

なぜGPUクラスタ on GKEなのか

GPUクラスタの構築方法の説明に入る前に、なぜGPUクラスタ on GKEが良いのかをご説明します。

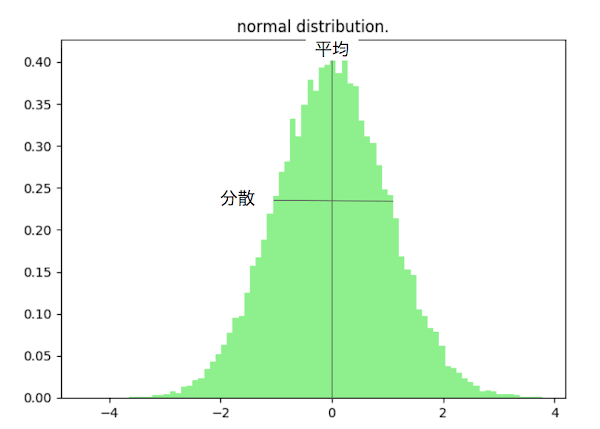

GPUの重要の高まり

最近は空前の機械学習ブームでGPUの需要が高いです。

Kubernetesはスケールさせやすく需要に応じて増やすことが出来るため、大量の計算リソースが必要な機械学習との相性がいいです。

弊社では機械学習だけでなく、3Dモデルのレンダリング処理にもGPUを活用しています。

アルファクラスタでGPUが使えるように

今までのGKEはGPUを搭載したノードを扱うことが出来なかったのですが、最近のアップデートでアルファクラスタであればGPUのノードが使えるようになりました。

ただ、デメリットとしてアルファクラスタには下記の制限があります。

- アルファクラスタは30日で自動削除。土下座しても削除されます。

- アップグレード不可

- Container Engine SLAの対象外

その為、プロダクション環境には向いていません。

GPUクラスタの作成手順

作成手順には大きく分けて2つあります。

- GPUのノードでクラスタ作成

- Nvidiaのドライバーのインストール

GPUのノードを含んだクラスタは簡単に作れるのですが、Nvidiaのドライバーのインストールはユーザーが行う必要があります。

そのため、クラスタ作成とドライバーのインストールの2つの手順が必要です。

GPUのノードでクラスタ作成

それではGPUのノードで構成されたクラスタを作って行きましょう。GKEで使えるGPUには2種類あります。使えるGPUはゾーンによって異なるので注意して下さい。

クラスタの作成には以下のgcloudコマンドを使います。

$ gcloud alpha container clusters create gpu-cluster --accelerator type=nvidia-tesla-k80,count=1 --zone=asia-east1-a --enable-kubernetes-alpha

gcloud alpha container clusters createはGKEのクラスタを作るコマンドです。

このコマンドのオプション–accelerator typeに使いたいGPUのタイプ指定、countにGPU数を指定して下さい。上記の例ではNvidia tesla k80をタイプに指定、数を1に指定しています。

コマンドの最後の–enable-kubernetes-alphaは指定しないとアルファの機能が使えないので、これは必ず指定して下さい。

クラスタの作成はこれで完了なので、次にドライバーのインストール手順について解説します。

2. Nvidiaのドライバーのインストール

先程作成したクラスタのGPUノードの全てにNvidiaのドライバーをインストールします。ドライバのインストール方法はいくつかあるのですが、今回はDaemonSetを使った方法をご紹介します。DaemonSetを使う理由は以下の通りです。

- GKEのノード(GCEのVM)はGKEが用意したインスタンステンプレートを使うのでVM作成時に自動的にドライバーをインストールするようなシェルを仕込むのが困難

- ノードの全てにSSHで入って手動でドライバー入れるのは辛い

- DaemonSetを使えばK8Sの仕組みで各ノードで自動的に実行される

上記の理由によりDaemonSetを使います。 おそらく、GKEのノードにドライバーなどを入れたい場合はDaemonSetを使うのが一番いい方法だと思います。

ちなみにDaemonSetはKubernetesの機能で、全て(or いくつか)のノードでPodを実行する仕組みです。そのためGPUのノードが後から増えた場合でも自動的にドライバーがインストールされます。

今回は下記のリポジトリにあるDaemonSetとDockerfileを使いドライバーをインストールします。

Nvidia GPU Installer for Container Optimized OS in Container Engine

インストール手順は以下のとおりです。

- DaemonSetで使うDocker Imageのbuildとpush

- DaemonSetをデプロイ

DaemonSetで使うDocker Imageのビルドとpush

それではDocker Imageをビルドしていきましょう。まず最初に上記のリポジトリをgit cloneします。

$ git clone git@github.com:ContainerEngine/accelerators.git

imageのbuildに入る前に違うバージョンのドライバーをインストールしたい場合は

accelerators/cos-nvidia-gpu-installer/installer.shの下記の箇所を編集して下さい。

現在(2017/10/02)では375.26のバージョンのNvidiaのドライバーがインストールされるようになっています。

accelerators/cos-nvidia-gpu-installer/installer.sh

51: NVIDIA_DRIVER_VERSION="375.26" # ここでインストールしたいバージョンを指定

55: NVIDIA_DRIVER_MD5SUM="d60819b2e377398c7296999ab5e7c1a4" #ここをインストールしたいバージョンのハッシュ値に変更。

97: echo "${NVIDIA_DRIVER_MD5SUM} ${pkg_name}" | md5sum --check # 上のハッシュ値の指定が面倒であれば、ここをコメントアウトすれば大丈夫です。

それではimageをbuildしてpushしましょう。

今回はGoogle Cloud Platform(GCP)のContainer Registry にpushするための例をご紹介します。{project name}の所は、各自書き換えて下さい。

$ cd accelerators/cos-nvidia-gpu-installer

$ docker build -t gcr.io/{project name}/cos-nvidia-installer .

$ gcloud docker -- push gcr.io/{project name}/cos-nvidia-installer

DaemonSetをデプロイ

次にDamemoSetをデプロイしていきましょう。下記のYAMLをコピー&ペーストして、image: の箇所を先程pushしたimage名に書き換え後にdaemonset.yamlという名前で保存して下さい。

apiVersion: extensions/v1beta1

kind: DaemonSet

metadata:

name: cos-nvidia-installer

namespace: kube-system

spec:

template:

metadata:

labels:

name: cos-nvidia-installer

spec:

hostNetwork: true

hostPID: true

volumes:

- name: dev

hostPath:

path: /dev

- name: nvidia-overlay

hostPath:

path: /home/kubernetes/bin/nvidia

- name: os-release

hostPath:

path: /etc/os-release

- name: sysrq

hostPath:

path: /proc/sysrq-trigger

containers:

- image: gcr.io/{project name}/cos-nvidia-installer # ここで先程、pushしたimageを指定

command: ["/bin/sh", "-c"]

args: ["usr/bin/nvidia-installer.sh && sleep infinity"]

name: nvidia-driver-installer

resources:

requests:

cpu: 0.15

securityContext:

privileged: true

env:

- name: BASE_DIR

value: "/rootfs/nvidia"

volumeMounts:

- name: nvidia-overlay

mountPath: /rootfs/nvidia

- name: dev

mountPath: /dev

- name: os-release

mountPath: /rootfs/etc/os-release

- name: sysrq

mountPath: /sysrq

先程保存したdamemonset.yamlをクラスタにデプロイします。

$ kubectl apply -f daemonset.yaml

デプロイが出来たかをgetコマンドで確認してみましょう。

$ kubectl get pod --namespace=kube-system NAME READY STATUS RESTARTS AGE cos-nvidia-installer-kltzw 0/1 ContainerCreating 0 19s

デプロイが上手く行っていればcos-nvidia-installerという名前のpodを表示されていると思います。

DaemonSetの実行状況が知りたければ、kubectl log コマンドで確認が出来ます。PodのSTATUSがRunningになってから下記のコマンドを使ってlogを確認してみましょう。

$ kubectl logs pod/cos-nvidia-installer-kltzw --namespace=kube-system

DaemonSet内のシェルスクリプトの処理が終了していれば下記のようなlogが得られると思います。

+ chmod -R a+rx /rootfs/nvidia/lib + chmod -R a+rx /rootfs/nvidia/bin Sending SIGTERM to kubelet + restart_kubelet + '[' false == true ']' + echo 'Sending SIGTERM to kubelet' + pidof kubelet + pkill -SIGTERM kubelet

まとめ

これで、GPUクラスタの構築が完了しました。次の記事ではPodからGPUを使う方法について解説します。

その他の記事

Other Articles

関連職種

Recruit