Kerasを用いた複数入力モデル精度向上のためのTips

はじめに

カブクで機械学習エンジニアをしている大串正矢です。今回は複数入力モデルの精度向上のためのTipsについて書きます。

背景

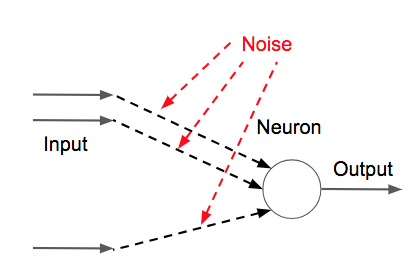

複数入力のモデルでは単一入力のモデルとは異なり、下記のような問題点があります。

– データによってロスに対する貢献度が異なり、ロスが下がりやすいデータを優先して学習してしまう。

– 学習の収束性はデータによって異なり、全体の最適化を目指すと個々のデータで過学習が発生してしまう。

1の問題を解決する方法として重み付きヘテロジニアスラーニング、2の問題を解決するためTask Wise Early Stoppingという手法が存在するので今回はその手法を紹介します。

- 注意点:両手法はマルチタスクラーニングに適用される手法のため、記事上ではタスクと表記しています。1入力を1タスクと置き換えて記述しています。

データ、前処理、モデル定義部分

データと前処理、モデル定義部分は前回の記事と同一なので省略します。

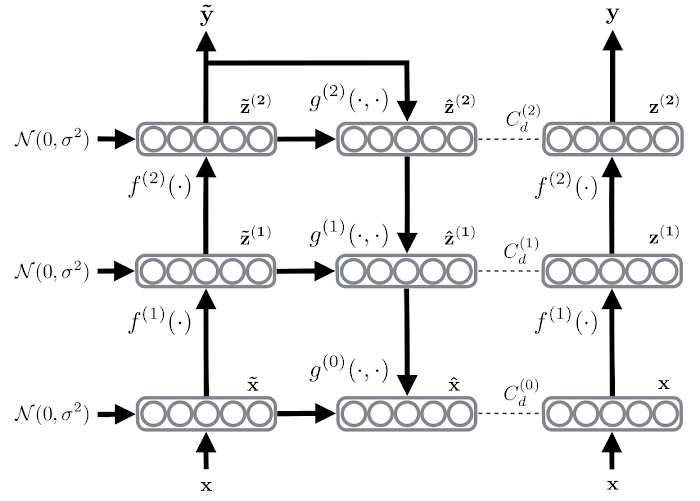

重み付きヘテロジニアスラーニング

重み付きヘテロジニアスラーニングは事前学習し、タスクごとのクラス重みを導出した後に重みを設定して再度学習する手法です。

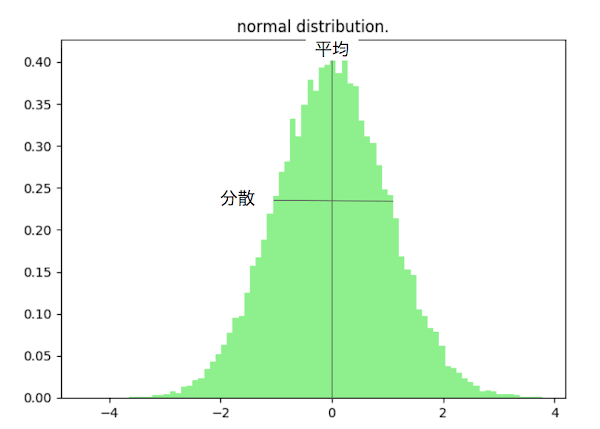

重みの導出方法は下記になります。

- タスク\(t\)の安定度を導出(検証データのロスの平均\(\mu_t\)、検証データのロスの標準偏差\(\sigma_t\) )

\begin{align}

N_t = \mu_t + 3 * \sigma_t

\end{align} -

基準タスクの選択

- \(N_t\)が最小のタスクを\(N_f\)とする

- 基準タスクとの安定度の比から重みを算出

\begin{align}

w_t = N_f / N_t

\end{align}

コードで処理するには下記のようになります。

コールバック関数を設定して学習の終了時に検証データのロスに対する平均と標準偏差を計算します。今回は下記のようなコールバック関数を作成しました。

from keras.callbacks import Callback

import numpy as np

from collections import OrderedDict

class HeteroGeniousCallbacks(Callback):

def __init__(self,

variable_number: int = 2,

):

super(HeteroGeniousCallbacks, self).__init__()

self.current_val_loss = {}

self.class_weight = {}

self.variable_number = variable_number

Epoch後の検証データのロスデータを貯める処理が下記になります。

def on_epoch_end(self, epoch, logs=None):

sort_logs = OrderedDict(

sorted(logs.items(), key=lambda x: x[0]))

for each_label, each_values in sort_logs.items():

if 'val' in each_label and 'loss' in each_label:

if each_label not in self.class_weight:

self.class_weight[each_label] = each_values

else:

each_values_tmp = self.class_weight[each_label]

each_value_list = np.vstack((each_values,

each_values_tmp))

self.class_weight[each_label] = each_value_list

学習終了後に基準タスクとの安定度の比から重みを導出します。

def on_train_end(self, logs=None):

self.class_weight = OrderedDict(

sorted(self.class_weight.items(), key=lambda x: x[0]))

val_stable_dict = {}

for each_label, each_value_lsit in self.class_weight.items():

val_stable_dict[each_label] = \

np.average(each_value_lsit) + 3.0 * np.std(each_value_lsit)

val_stable_dict = OrderedDict(

sorted(val_stable_dict.items(), key=lambda x: x[1]))

most_stable_value = [value for value in val_stable_dict.values()][0]

index = 0

tmp_class_weight = {}

for each_label in self.class_weight.keys():

tmp_class_weight[index] = \

val_stable_dict[each_label] / most_stable_value

if index >= self.variable_number - 1:

break

index += 1

self.class_weight = tmp_class_weight

print('hetero genious class weight {}'.format(self.class_weight))

実際に使用するには下記のように行います。

コールバック関数を指定して重みを計算

hetero_genious_callbacks = HeteroGeniousCallbacks()

model.fit(x, x, validation_split=0.1, epochs=1000, callbacks=[hetero_genious_callbacks])

コールバック関数で導出された重みを設定して再学習

model.fit(x, x, validation_split=0.1, epochs=1000,

class_weight=hetero_genious_callbacks.class_weight,)

Task wise Early Stopping

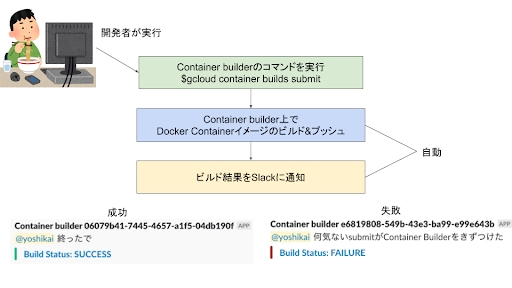

この手法はタスクごとに学習の収束性が異なるため、タスクごとに学習が収束したら学習を止める手法になります。手法はシンプルなのですがDefine and RUN型のフレームワークで実装している場合は学習中の柔軟な変更が難しく、少し強引に実現しました。

流れとしては下記のようになっています。

1 観測するタスクを指定

2 タスクのロスが収束してきたら学習を止める

3 タスクに関連するレイヤーをフリーズして再度、学習を開始

4 2と3を繰り返し、1で指定したタスク全てが収束すれば終了

注意点として学習中にレイヤーをフリーズしても反映されず、再度compile後に学習をする必要があります。

コードで実現するには下記のようになります。ほぼKerasで標準実装されているEarlyStopと同一ですがどのロスを見て止まったか把握する必要があります。

初期設定部分で観測していたどの値で止まったかを確認するための変数を定義します。self.stop_monitorがその部分に当たります。

class TaskWiseEarlyStopping(Callback):

def __init__(self,

monitor='val_loss',

min_delta=0,

patience=0,

verbose=0,

mode='auto',

baseline=None,

restore_best_weights=False):

super(TaskWiseEarlyStopping, self).__init__()

self.monitor = monitor

self.baseline = baseline

self.patience = patience

self.verbose = verbose

self.min_delta = min_delta

self.wait = 0

self.stopped_epoch = 0

self.restore_best_weights = restore_best_weights

self.best_weights = None

self.stop_monitor = None

epochごとに観測している値が向上していない場合に学習を止めます。self.stop_monitor = self.monitorでどの値で止まったをチェックします。

def on_epoch_end(self, epoch, logs=None):

current = self.get_monitor_value(logs)

if current is None:

return

if self.monitor_op(current - self.min_delta, self.best):

self.best = current

self.wait = 0

if self.restore_best_weights:

self.best_weights = self.model.get_weights()

else:

self.wait += 1

if self.wait >= self.patience:

self.stopped_epoch = epoch

self.model.stop_training = True

self.stop_monitor = self.monitor

if self.restore_best_weights:

if self.verbose > 0:

print('Restoring model weights from the end of '

'the best epoch')

self.model.set_weights(self.best_weights)

上記までがTaskWiseEarlyStoppingのコールバック関数に関してです。ここからはこのコールバック関数に実際に値を設定して処理を行います。

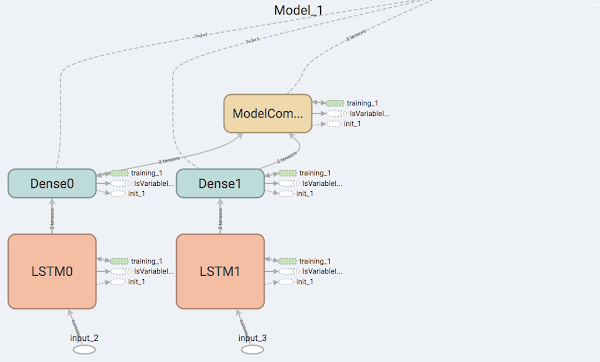

モデルの出力値のどの部分をチェックするかは下記のコードで設定します。今回のモデルはdenseが出力になるのでdenseの末尾にlossを加え監視項目としています。

monitor_list = ['val_' + layer.name + '_loss' for layer in model.layers if 'dense' in layer.name]

callbacks_list = [TaskWiseEarlyStopping(monitor=monitor, patience=30, verbose=1) for monitor in monitor_list]

EarlyStopが適用された後で、どのレイヤーがストップしたかを確認します。設定したTaskWiseEarlyStopのコールバック群の中で学習を中止したものがあればそのstop_monitorがNoneではなく観測していた出力になるのでその値を取得します。

stop_layer = ''

stop_loss = ''

for callback in callbacks_list:

if callback.stop_monitor is not None:

stop_layer = callback.stop_monitor.replace('_loss', '')

stop_loss = callback.stop_monitor

学習を中止した出力に関係するレイヤーは次回の学習では学習しないようにレイヤーをフリーズ(学習を行わない)処理します。

stop_input_layer = ''

for layer in model.layers:

if layer.name == stop_layer:

layer.trainable = False

stop_input_layer = layer.input.name.split('/')[2]

for layer in model.layers:

if layer.name == stop_input_layer:

layer.trainable = False

compile処理によってフリーズしたレイヤーを適用し、model.summary()で学習するパラメータが減っているか確認します。

model.compile(optimizer='adam', loss='mean_squared_error', metrics=['mse'])

model.summary()

下記が確認した結果です。学習しないパラメータ数が分かるNon-trainable paramsが0でないことが確認できます。

__________________________________________________________________________________________________

Layer (type) Output Shape Param # Connected to

==================================================================================================

input_9 (InputLayer) (None, 3, 1) 0

__________________________________________________________________________________________________

input_10 (InputLayer) (None, 3, 1) 0

__________________________________________________________________________________________________

lstm_9 (LSTM) (None, 3, 120) 58560 input_9[0][0]

__________________________________________________________________________________________________

lstm_10 (LSTM) (None, 3, 150) 91200 input_10[0][0]

__________________________________________________________________________________________________

dense_9 (Dense) (None, 3, 1) 121 lstm_9[0][0]

__________________________________________________________________________________________________

dense_10 (Dense) (None, 3, 1) 151 lstm_10[0][0]

==================================================================================================

Total params: 150,032

Trainable params: 91,351

Non-trainable params: 58,681

__________________________________________________________________________________________________

上記の結果だけでなくロスが変更されていないか確認も必要です。下記はdense_9_lossがフリーズされて学習が進まない結果です。dense_9_lossが変更されていないことが確認できます。

Epoch 1/800

150/150 [==============================] - 1s 3ms/step - loss: 3.8935e-04 - dense_9_loss: 1.6028e-07 - dense_10_loss: 3.8919e-04 - dense_9_mean_squared_error: 1.6028e-07 - dense_10_mean_squared_error: 3.8919e-04

Epoch 2/800

150/150 [==============================] - 0s 168us/step - loss: 1.9313e-04 - dense_9_loss: 1.6028e-07 - dense_10_loss: 1.9297e-04 - dense_9_mean_squared_error: 1.6028e-07 - dense_10_mean_squared_error: 1.9297e-04

Epoch 3/800

150/150 [==============================] - 0s 162us/step - loss: 1.3634e-04 - dense_9_loss: 1.6028e-07 - dense_10_loss: 1.3618e-04 - dense_9_mean_squared_error: 1.6028e-07 - dense_10_mean_squared_error: 1.3618e-04

Epoch 4/800

150/150 [==============================] - 0s 166us/step - loss: 8.3967e-05 - dense_9_loss: 1.6028e-07 - dense_10_loss: 8.3807e-05 - dense_9_mean_squared_error: 1.6028e-07 - dense_10_mean_squared_error: 8.3807e-05

Epoch 5/800

150/150 [==============================] - 0s 167us/step - loss: 5.1792e-05 - dense_9_loss: 1.6028e-07 - dense_10_loss: 5.1631e-05 - dense_9_mean_squared_error: 1.6028e-07 - dense_10_mean_squared_error: 5.1631e-05

Epoch 6/800

150/150 [==============================] - 0s 167us/step - loss: 3.2854e-05 - dense_9_loss: 1.6028e-07 - dense_10_loss: 3.2694e-05 - dense_9_mean_squared_error: 1.6028e-07 - dense_10_mean_squared_error: 3.2694e-05

:

結果

実験条件

- 実行環境

- OS: macOS Sierra

- CPU: 2.9 GHz Intel Core i7

- メモリー: 16 GB 2133 MHz LPDDR3

- pythonバージョン

- 3.6.0

- ライブラリ

numpy==1.15.1

ipython==6.0.0

notebook==5.0.0

pandas==0.23.4

matplotlib==2.0.1

lxml==4.2.0

beautifulsoup4==4.6.0

scikit-learn==0.18.1

scipy==1.1.0

keras==2.2.2

tensorflow==1.8.0

-

モデル

-

LSTM

- ノード数:120, 個別入力は気温変化が120, ガスの生産量は150

- 他のパラメータはKearasで提供されているデフォルト値

- Optimiser

- adam

- 他のパラメータはKearasで提供されているデフォルト値

- epoch

- 1000

- EarlyStop(過学習を抑え、学習時間を短縮するために導入)

- 検証データのロスが10epoch改善しない場合は強制的に止める処理

重み付きヘテロジニアスラーニング

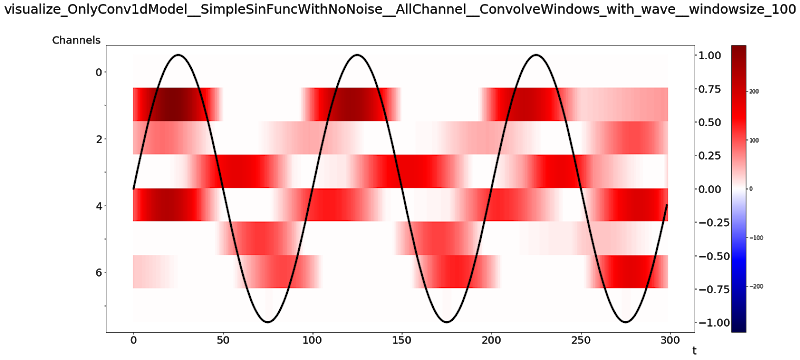

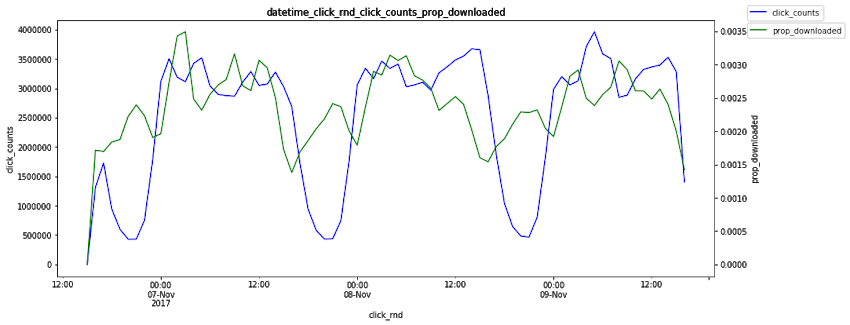

重み付きヘテロジニアスラーニングの効果を確認します。

今回のデータでは事前学習の結果、入力0のデータが基準データとなり入力1のデータの学習が上手く進んでいないので導出された重みは下記になります。

{0: 1.0, 1: 9.7779}

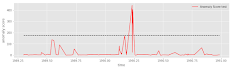

これが適用された際の検証データにおけるロスがどのように変化しているかを見てみます。青が重み付きヘテロジニアスラーニングを適用する前で赤が適用後になります。

結果より適用後の方がロスが僅かに下がっており、入力0に対しては重要性を下げたことによる過学習の抑止、入力1に対しては重要度を上げたことによる学習の促進につながったと推測できます。

- 入力0のケース

- 入力1のケース

テストデータのRMSE

テストデータのRMSEを何も適用していないケースと重み付きヘテロジニアスラーニング、TaskWiseEarlyStoppingを適用した場合の値を比較します。

重み付きヘテロジニアスラーニングを適用した場合が最もRMSEが低く効果が高いことが伺えます。

| 各手法 | RMSE |

|---|---|

| 何もなし | 0.0907 |

| 重み付きヘテロジニアスラーニング | 0.0782 |

| TaskWiseEarlyStopping | 0.0829 |

最後に

弊社では標準的な実装例では解決できないような問題を解決できるスキルの高いエンジニアも絶賛採用中なので是非、弊社へ応募してください。

参考

https://www.slideshare.net/Takayosi/miru2018-tutorial-108675245/93

その他の記事

Other Articles

関連職種

Recruit